KI-Verbesserung

Optionale Funktion - Sie können dies überspringen!

Dieser Schritt ist vollständig optional. Vox funktioniert perfekt ohne KI-Verbesserung - Ihre Transkriptionen werden bereits präzise sein. Konfigurieren Sie dies nur, wenn Sie Ihre Transkriptionen automatisch aufpolieren möchten (Grammatik korrigieren, Füllwörter wie "äh" oder "ähm" entfernen).

Wenn Sie nicht sicher sind, was das ist, oder es jetzt nicht einrichten möchten, können Sie gerne zum nächsten Abschnitt übergehen!

KI-Verbesserung verwendet KI (wie ChatGPT oder Claude), um Ihre Transkriptionen automatisch zu bereinigen und professioneller zu gestalten.

Was Bewirkt die KI-Verbesserung?

Einfach ausgedrückt: Sie nimmt Ihre Transkription (die bereits präzise ist) und lässt sie professioneller klingen.

Beispiel:

- Vor der KI: "Äh, also im Grunde, ich meine, wir müssen, ähm, ein Meeting für, Sie wissen schon, nächsten Dienstag planen"

- Nach der KI: "Wir müssen ein Meeting für nächsten Dienstag planen"

Hauptvorteile

- Korrigiert Grammatik: Behebt Fehler automatisch

- Entfernt Füllwörter: Beseitigt "äh", "ähm", "also", usw.

- Macht es sauberer: Professioneller und einfacher zu lesen

- Behält Ihre Bedeutung: Ihre ursprüngliche Nachricht bleibt gleich

Benötigen Sie Dies?

Sie möchten vielleicht KI-Verbesserung wenn:

- Sie Vox für professionelle Dokumente oder E-Mails verwenden

- Sie möchten, dass Ihre Transkriptionen ohne Bearbeitung poliert aussehen

- Sie mit KI-Diensten (wie ChatGPT) vertraut sind

Sie benötigen KI-Verbesserung NICHT wenn:

- Sie nur schnelle persönliche Notizen machen

- Sie vollständige Privatsphäre bevorzugen (KI-Verbesserung sendet Text an externe Dienste)

- Sie Transkriptionen gerne manuell bearbeiten

- Sie nicht wissen, was ein "API-Schlüssel" ist

Datenschutzhinweis

Ihr Audio verlässt niemals Ihr Gerät. Nur die Texttranskription wird an den KI-Dienst Ihrer Wahl gesendet. Wenn Sie vollständige Privatsphäre wünschen, lassen Sie die KI-Verbesserung deaktiviert.

Einrichtung

Anforderungen

Um die KI-Verbesserung zu nutzen, benötigen Sie:

- Ein Konto bei einem KI-Dienst (wie OpenAI, Anthropic, AWS usw.)

- Einen API-Schlüssel (stellen Sie ihn sich wie ein Passwort für den KI-Dienst vor)

- Einige Dollar für KI-Kosten (normalerweise $0,01-0,05 pro Transkription)

Demnächst: Wir arbeiten an einer integrierten kostenpflichtigen Option, damit Sie dies nicht selbst einrichten müssen.

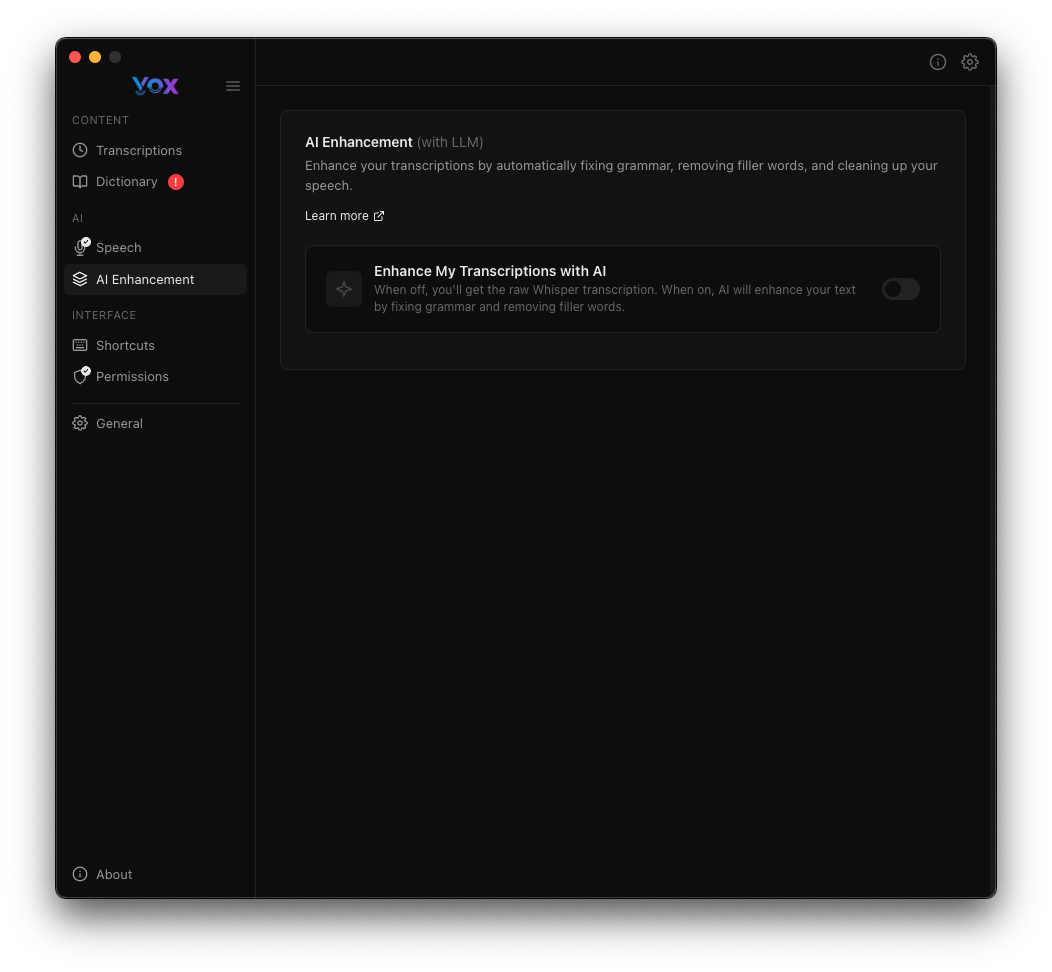

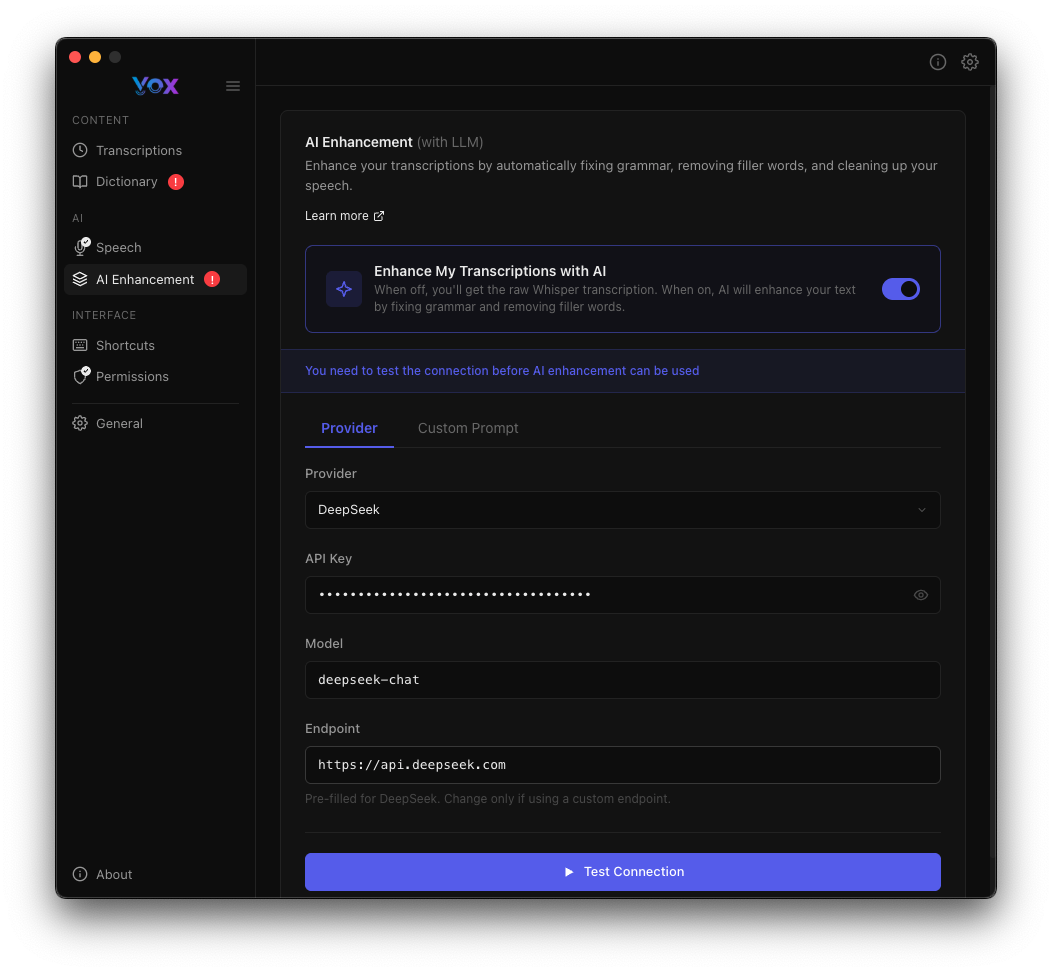

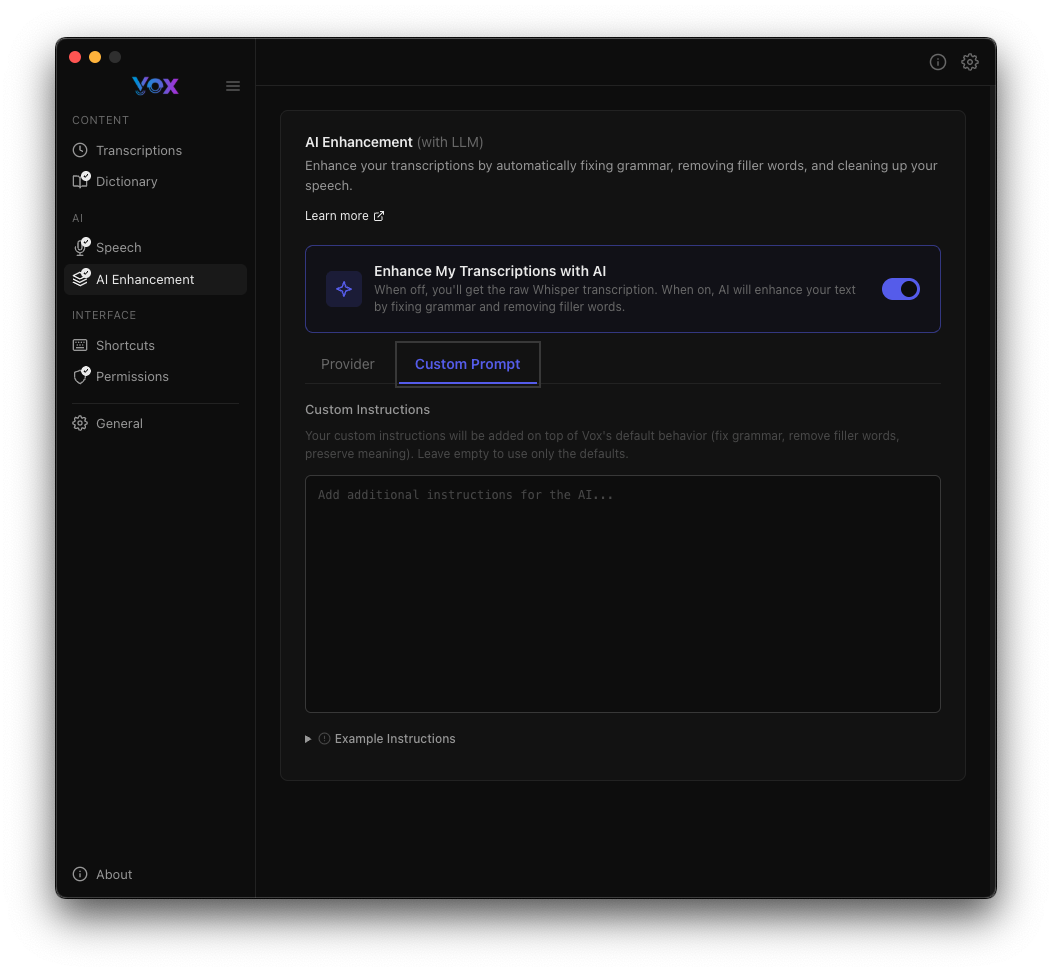

Schritt 1: KI-Verbesserungseinstellungen Öffnen

- Öffnen Sie die Vox-Einstellungen

- Klicken Sie auf KI-Verbesserung in der Seitenleiste

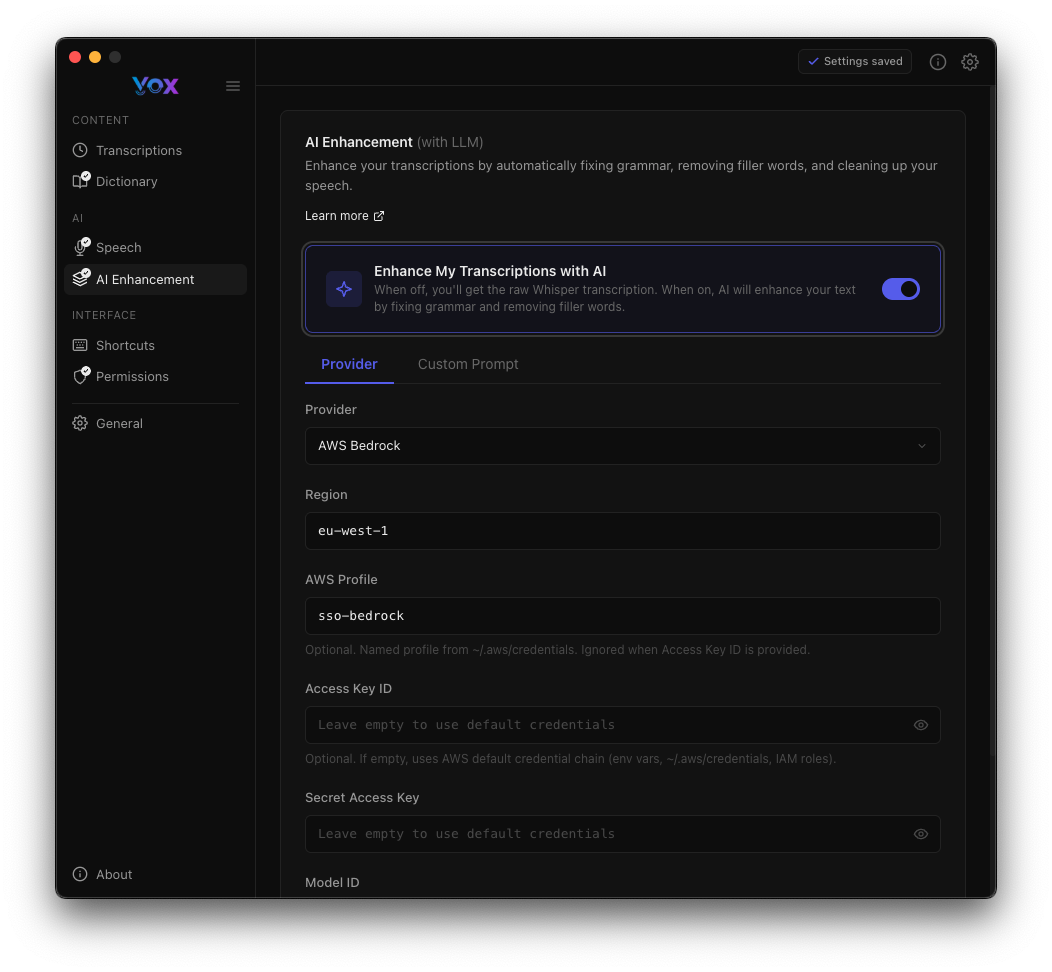

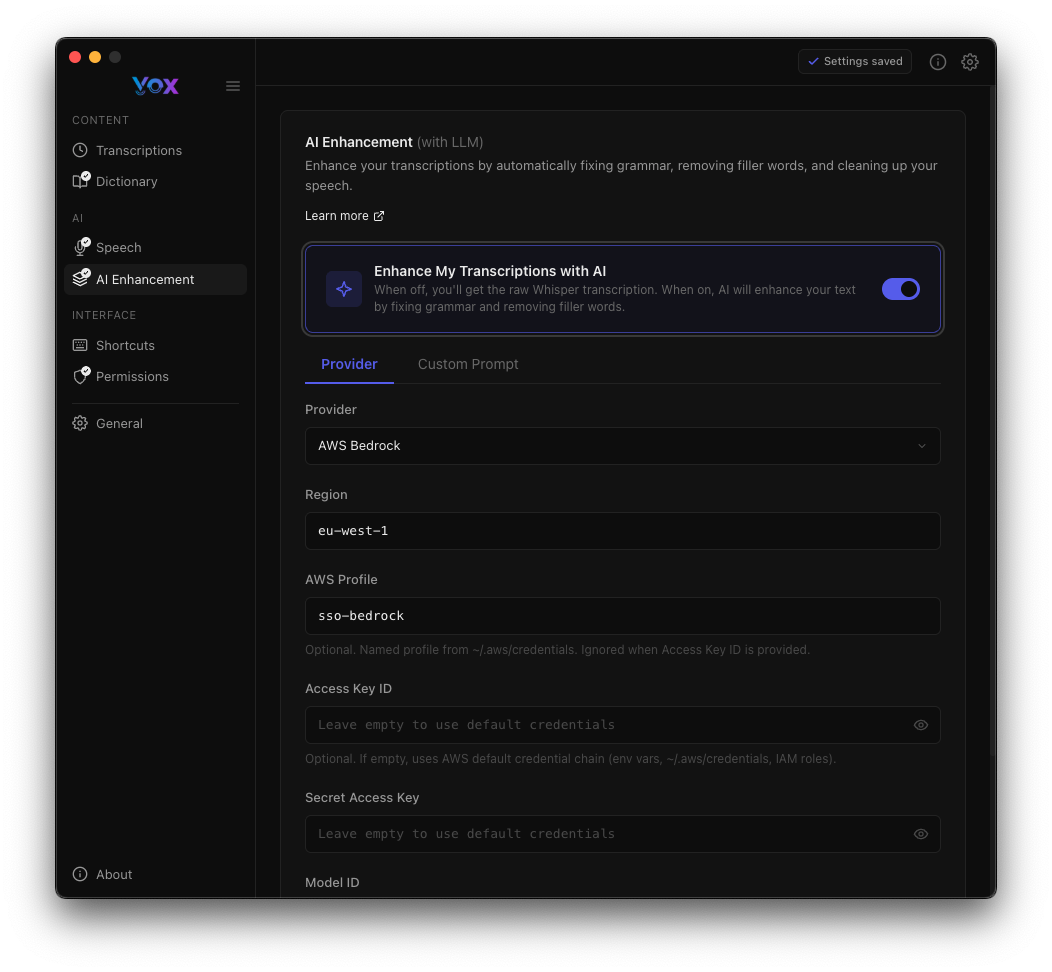

- Schalten Sie Meine Transkriptionen mit KI Verbessern EIN

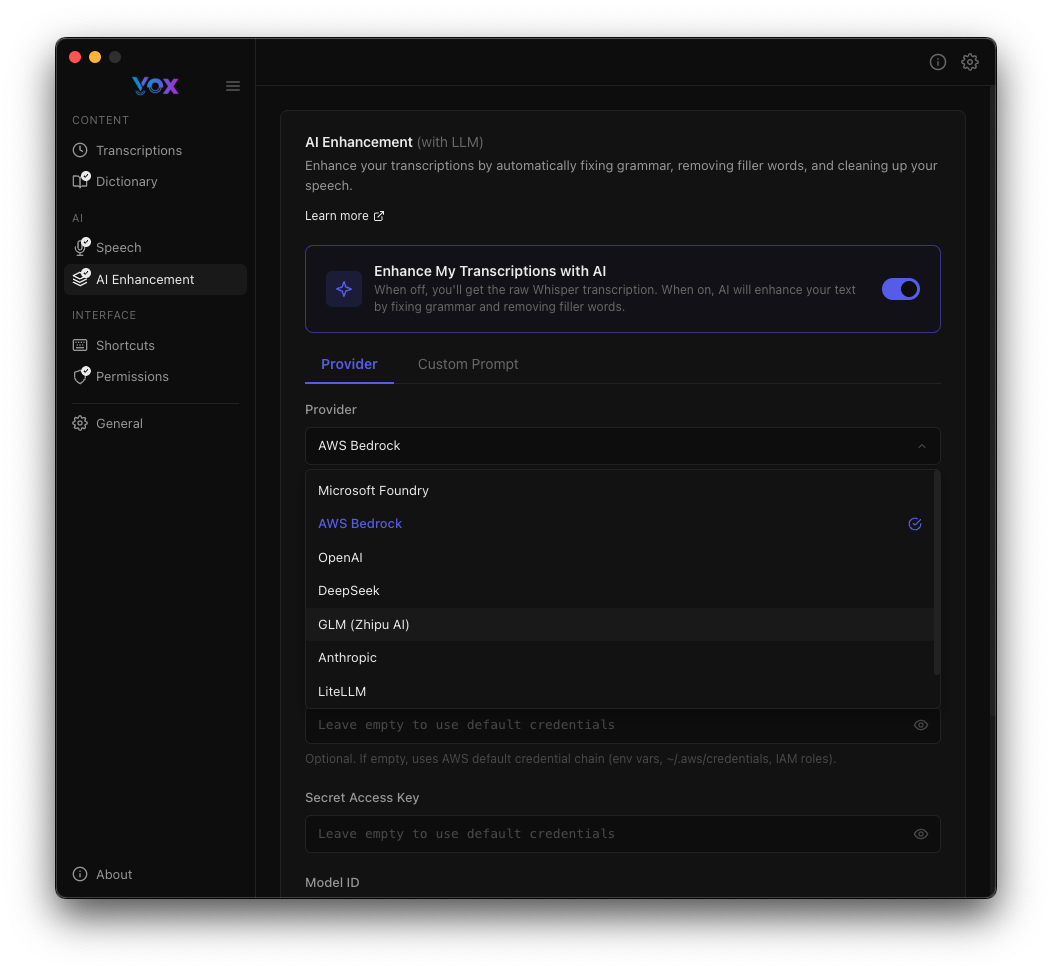

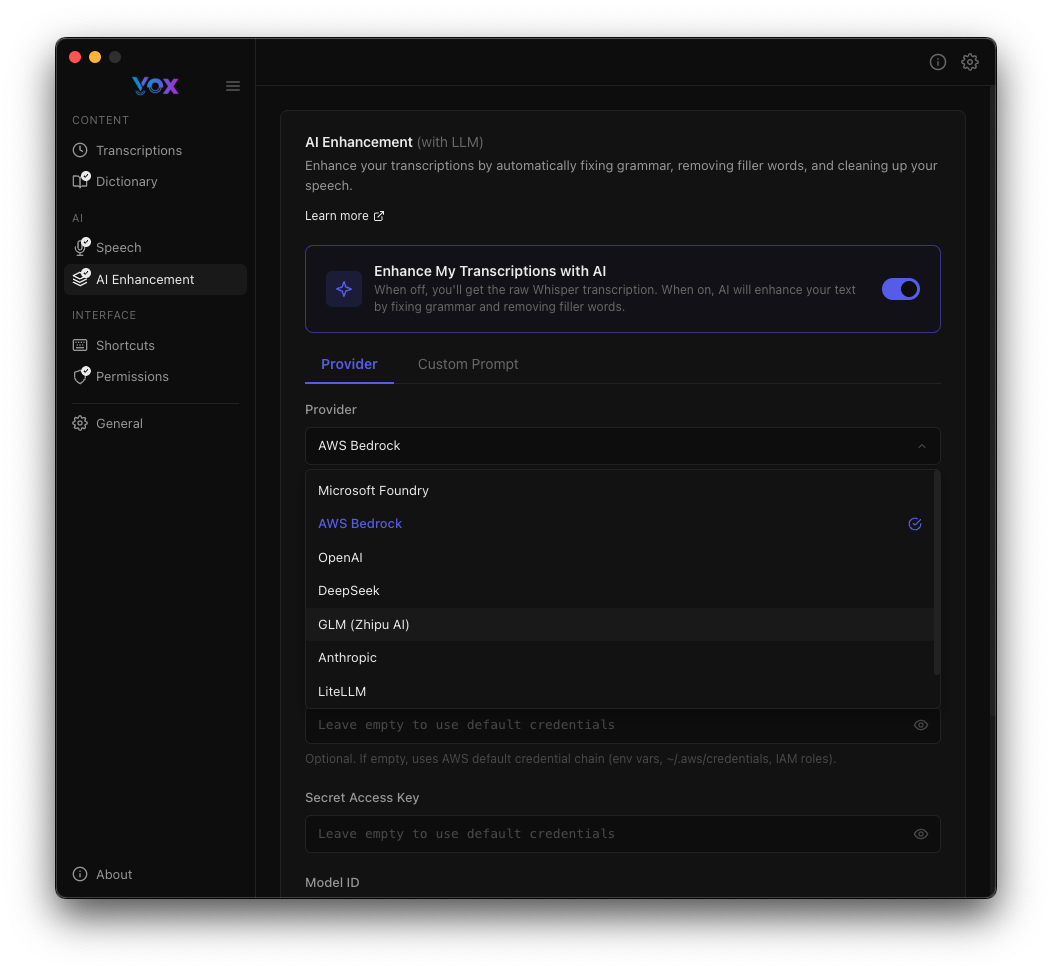

Schritt 2: Ihren KI-Anbieter Wählen

Wählen Sie einen KI-Dienst aus dem Dropdown-Menü. Beliebte Optionen:

- OpenAI (ChatGPT) - Beliebtester, einfach zu verwenden

- Anthropic (Claude) - Gute Qualität, datenschutzorientiert

- AWS Bedrock - Für fortgeschrittene Benutzer

- Ollama - KI lokal ausführen (kostenlos, aber Einrichtung erforderlich)

Schritt 3: Ihren API-Schlüssel Hinzufügen

- Holen Sie sich einen API-Schlüssel von Ihrem gewählten Anbieter (siehe Anbieterabschnitte unten)

- Fügen Sie ihn in das API-Schlüssel Feld ein

- Klicken Sie auf Verbindung Testen, um sicherzustellen, dass es funktioniert

Zum Ersten Mal?

Wenn Sie noch nie KI-APIs verwendet haben, empfehlen wir, mit OpenAI (ChatGPT) zu beginnen. Sie haben klare Preise ($0,002 pro Anfrage) und gute Dokumentation.

Unterstützte Anbieter

Vox unterstützt mehrere KI-Anbieter. Klicken Sie auf das Anbieter Dropdown um auszuwählen:

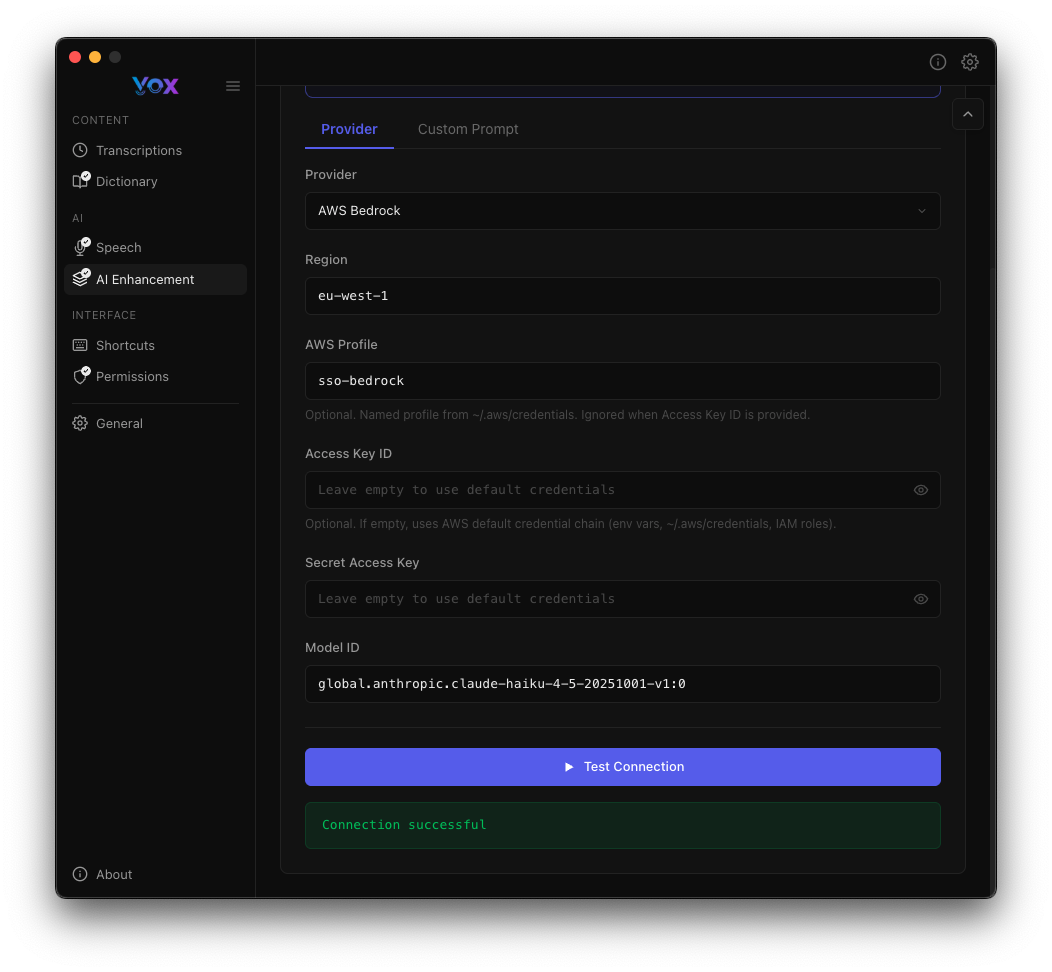

AWS Bedrock

Am besten für: Produktionseinsatz, Unternehmensumgebungen, Modellvielfalt

Konfiguration:

Region

- Wählen Sie Ihre AWS-Region (z.B.

eu-west-1) - Wählen Sie eine Region in Ihrer Nähe für geringere Latenz

AWS-Profil

- Geben Sie Ihren AWS-Profilnamen ein (z.B.

sso-bedrock) - Verwendet AWS-CLI-Anmeldeinformationen, die auf Ihrem System konfiguriert sind

Zugriffsschlüssel-ID

- Optional: Geben Sie Ihren AWS-Zugriffsschlüssel ein

- Erforderlich wenn keine AWS-CLI-Profile verwendet werden

- Format:

AKIA...(20 Zeichen)

Geheimer Zugriffsschlüssel

- Optional: Geben Sie Ihren geheimen Zugriffsschlüssel ein

- Erforderlich wenn keine AWS-CLI-Profile verwendet werden

- Sicher im macOS-Schlüsselbund / Windows-Anmeldeinformationsspeicher gespeichert

Modell-ID

- Geben Sie das zu verwendende Bedrock-Modell an

- Beispiel:

global.anthropic.claude-haiku-4-5-20251101-v1:0 - Siehe AWS Bedrock Modelle

AWS-Einrichtung

AWS Bedrock erfordert:

- Ein AWS-Konto mit Bedrock-Zugang

- IAM-Berechtigungen für das ausgewählte Modell

- AWS CLI mit SSO oder Zugriffsschlüsseln konfiguriert

DeepSeek

Am besten für: Kostengünstige KI-Verbesserung, gute Leistung

Konfiguration:

API-Schlüssel

- Holen Sie sich einen API-Schlüssel von DeepSeek

- Sicher im macOS-Schlüsselbund / Windows-Anmeldeinformationsspeicher gespeichert

Modell

- Geben Sie das Modell an (z.B.

deepseek-chat) - Siehe DeepSeek API-Dokumentation

Endpoint

- Standard:

https://api.deepseek.com - Nur ändern wenn ein benutzerdefinierter Endpoint verwendet wird

Microsoft Foundry

Am besten für: Azure-Benutzer, Unternehmensintegration

Konfiguration:

- Ähnlich wie AWS Bedrock

- Erfordert Azure-Abonnement und Foundry-Zugang

- Verwendet Azure-Authentifizierung

OpenAI

Am besten für: Hochwertige GPT-Modelle, einfachste Einrichtung

Konfiguration:

- API-Schlüssel: Von OpenAI Platform

- Modell:

gpt-4,gpt-4-turbo,gpt-3.5-turbo, usw. - Endpoint: Standard

https://api.openai.com/v1

GLM (Zhipu AI)

Am besten für: Chinesische Sprachtranskription, Benutzer im asiatisch-pazifischen Raum

Konfiguration:

- API-Schlüssel: Von Zhipu AI

- Modell:

glm-4,glm-4-air, usw.

Anthropic

Am besten für: Claude-Modelle mit hoher Reasoning-Fähigkeit

Konfiguration:

- API-Schlüssel: Von Anthropic Console

- Modell:

claude-3-5-sonnet-20241022,claude-3-opus-20240229, usw.

LiteLLM

Am besten für: Fortgeschrittene Benutzer, benutzerdefiniertes Modell-Routing, einheitliche API

Konfiguration:

- Endpoint: Ihre LiteLLM-Server-URL

- Unterstützt Routing zu 100+ LLM-Anbietern

- Siehe LiteLLM-Dokumentation

Ihre Verbindung Testen

Nach der Konfiguration Ihres Anbieters:

- Klicken Sie auf Verbindung Testen

- Warten Sie, bis der Test abgeschlossen ist

- Suchen Sie nach der Meldung "Verbindung erfolgreich!"

Wenn der Test fehlschlägt:

- Überprüfen Sie, ob Ihre API-Schlüssel/Anmeldeinformationen korrekt sind

- Prüfen Sie Ihre Internetverbindung

- Stellen Sie sicher, dass Ihr Konto Zugang zum angegebenen Modell hat

- Überprüfen Sie Fehlermeldungen auf spezifische Probleme

Schlüsselbund-Zugang

Möglicherweise müssen Sie die Schlüsselbund-Berechtigung erteilen, um API-Schlüssel sicher zu speichern.

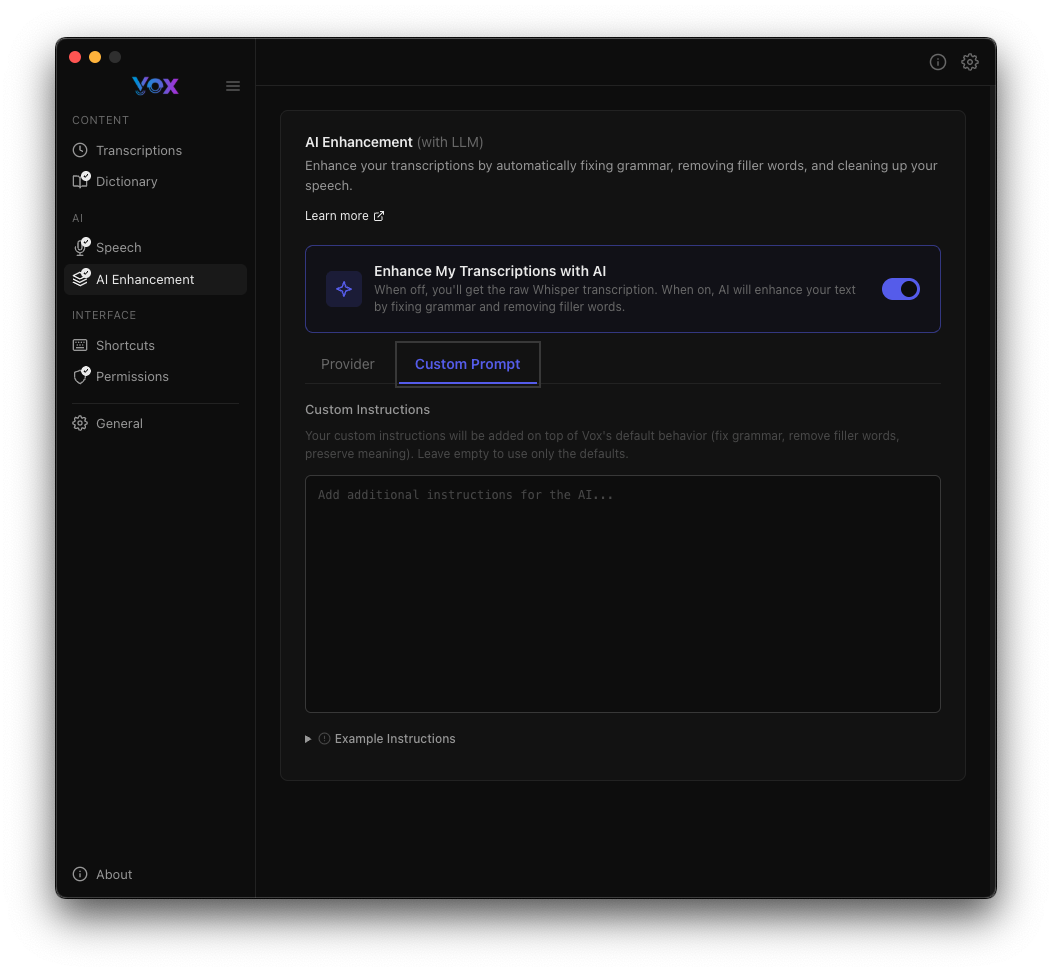

Benutzerdefinierte Prompts

Passen Sie an, wie KI Ihre Transkriptionen verbessert:

Benutzerdefinierte Prompts Verwenden

- Klicken Sie auf den Tab Benutzerdefinierter Prompt

- Geben Sie Ihre benutzerdefinierten Anweisungen ein

- Einstellungen werden automatisch gespeichert

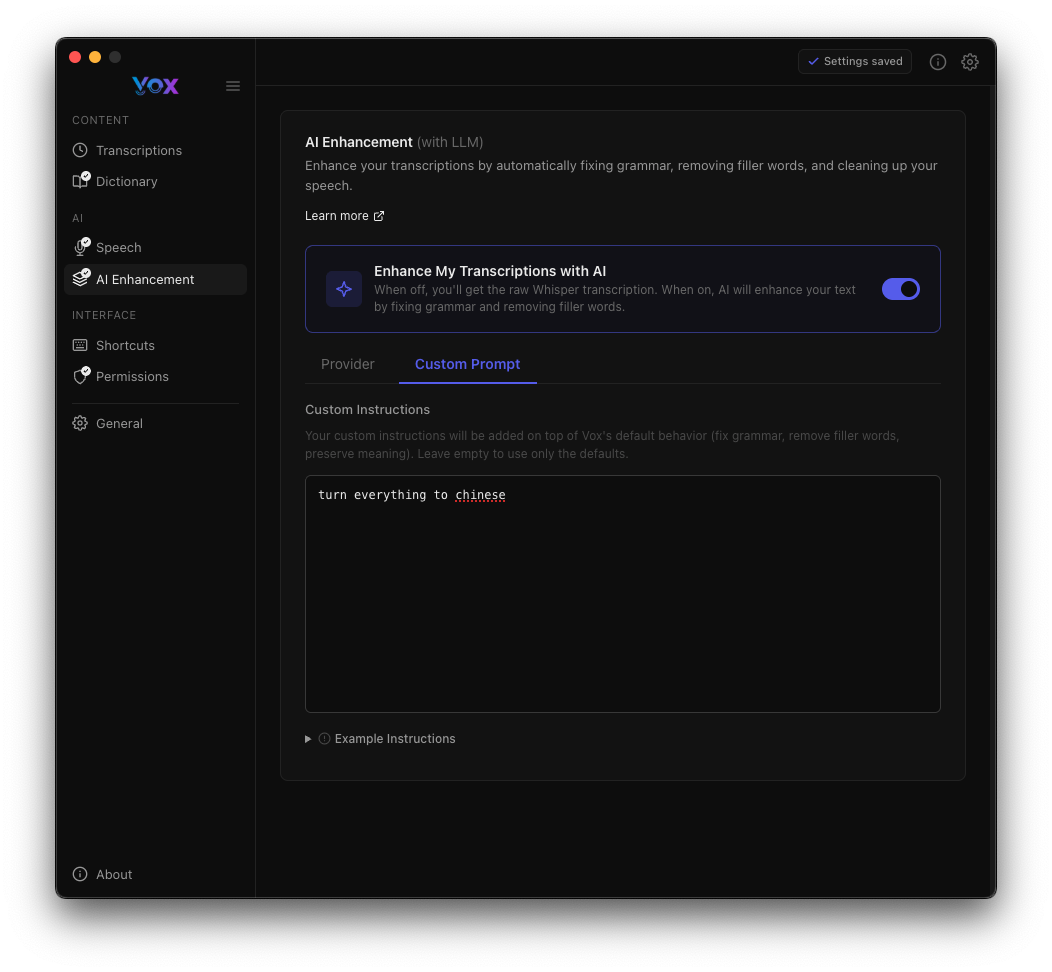

Beispiel für Benutzerdefinierten Prompt

Beispiel-Prompt:

turn everything to chineseDies übersetzt alle Transkriptionen ins Chinesische.

Standard-Prompt

Wenn Sie keinen benutzerdefinierten Prompt angeben, verwendet Vox eine Standard-Anweisung um:

- Grammatik und Rechtschreibung zu korrigieren

- Füllwörter zu entfernen (äh, ähm, also, usw.)

- Technische Begriffe und Namen beizubehalten

- Die ursprüngliche Bedeutung beizubehalten

Prompt-Tipps

Gute Prompts:

- "Grammatik korrigieren, aber technischen Fachjargon beibehalten"

- "Füllwörter entfernen und als Aufzählungspunkte formatieren"

- "Ins Spanische übersetzen und Grammatik korrigieren"

- "Formeller und professioneller machen"

Vermeiden Sie:

- Extrem lange Prompts (können Token-Limits erreichen)

- Prompts, die die Bedeutung erheblich verändern

- Prompts, die Informationen hinzufügen, die nicht in der Transkription enthalten sind

Experimentieren Sie

Testen Sie verschiedene Prompts mit derselben Transkription, um herauszufinden, was für Ihren Anwendungsfall am besten funktioniert.

Beispielanweisungen

Beispiel für benutzerdefinierte Anweisungen in der Benutzeroberfläche:

Klicken Sie auf Beispielanweisungen, um Beispiel-Prompts zu sehen:

- "Fügen Sie zusätzliche Anweisungen über Vox's Standardverhalten hinzu, wie Grammatik, Füllwörter entfernen, Zögerungsphrasen"

- Gibt Anleitung, wie Sie Ihre benutzerdefinierten Anweisungen strukturieren können

Anbieterspezifische Anleitungen

AWS Bedrock Einrichtung

Voraussetzungen:

- AWS-Konto mit Bedrock-Zugang

- Modellzugang in der AWS-Konsole aktiviert

- IAM-Berechtigungen konfiguriert

AWS CLI-Profil Verwenden (Empfohlen):

# AWS CLI mit SSO konfigurieren

aws configure sso

# Ihr Profil testen

aws bedrock list-foundation-models --profile sso-bedrockIn Vox:

- Wählen Sie den Anbieter AWS Bedrock

- Geben Sie den Profilnamen ein (z.B.

sso-bedrock) - Wählen Sie die Region

- Geben Sie die Modell-ID ein

- Klicken Sie auf Verbindung Testen

Zugriffsschlüssel Verwenden:

- Zugriffsschlüssel in AWS IAM erstellen

- Zugriffsschlüssel-ID und geheimen Zugriffsschlüssel in Vox eingeben

- Region und Modell auswählen

- Auf Verbindung Testen klicken

Sicherheit

Speichern Sie Zugriffsschlüssel sicher. AWS CLI-Profile mit SSO sind sicherer als statische Zugriffsschlüssel.

DeepSeek Einrichtung

Voraussetzungen:

- Konto auf platform.deepseek.com

- API-Schlüssel generiert

Einrichtung:

- Bei DeepSeek registrieren

- API-Schlüssel generieren

- In Vox den Anbieter DeepSeek auswählen

- Ihren API-Schlüssel eingeben

- Modell

deepseek-chatverwenden - Auf Verbindung Testen klicken

Kosten: DeepSeek ist im Vergleich zu anderen Anbietern kostengünstig.

OpenAI Einrichtung

Voraussetzungen:

- OpenAI-Konto

- API-Schlüssel mit Guthaben

Einrichtung:

- API-Schlüssel von platform.openai.com/api-keys holen

- In Vox den Anbieter OpenAI auswählen

- Ihren API-Schlüssel eingeben

- Modell wählen (z.B.

gpt-4-turbo,gpt-3.5-turbo) - Auf Verbindung Testen klicken

Kosten: OpenAI berechnet pro Token. GPT-4 ist teurer, aber qualitativ hochwertiger als GPT-3.5.

Kostenüberlegungen

Preisübersicht

KI-Verbesserungskosten variieren je nach Anbieter:

| Anbieter | Kosten pro 1M Token | Anmerkungen |

|---|---|---|

| DeepSeek | ~$0,14 | Am kostengünstigsten |

| OpenAI GPT-3.5 | ~$0,50 | Gutes Preis-Leistungs-Verhältnis |

| OpenAI GPT-4 | ~$10-30 | Hohe Qualität, teuer |

| AWS Bedrock | ~$0,25-15 | Variiert je nach Modell |

| Anthropic Claude | ~$3-15 | Hohe Qualität |

Kosten Schätzen

Durchschnittliche Transkription: 50-100 Token Kosten pro Transkription: $0,001-0,01 (je nach Anbieter)

Beispielnutzung:

- 100 Transkriptionen/Tag mit DeepSeek: ~$0,50/Monat

- 100 Transkriptionen/Tag mit GPT-4: ~$30/Monat

Geld Sparen

- Verwenden Sie kleinere, günstigere Modelle für einfache Transkriptionen

- Verwenden Sie GPT-4 oder Claude nur wenn Sie höchste Qualität benötigen

- DeepSeek bietet das beste Preis-Leistungs-Verhältnis

Zukünftige Preise

Integrierte KI Kommt Bald

Derzeit verwendet Vox Ihre eigenen API-Schlüssel für die KI-Verbesserung. In Zukunft bieten wir möglicherweise eine integrierte kostenpflichtige KI-Modelloption zur Vereinfachung an.

Dies würde die Notwendigkeit, API-Schlüssel zu verwalten, eliminieren und möglicherweise bieten:

- Vereinfachte Einrichtung (keine API-Schlüssel erforderlich)

- Vorhersehbare monatliche Preise

- Integrierte Abrechnung

- Für Transkription optimierte Modelle

Bleiben Sie auf dem Laufenden!

Bewährte Vorgehensweisen

Wann KI-Verbesserung Verwenden

KI-Verbesserung verwenden für:

- Professionelle E-Mails und Dokumentation

- Besprechungsnotizen und Zusammenfassungen

- Content-Erstellung und Schreiben

- Formelle Kommunikation

KI-Verbesserung überspringen für:

- Schnelle persönliche Notizen

- Wenn vollständige Privatsphäre erforderlich ist

- Einfache, kurze Transkriptionen

- Wenn Geschwindigkeit kritisch ist

Einen Anbieter Wählen

Wählen Sie AWS Bedrock wenn Sie:

- AWS bereits für andere Dienste nutzen

- Sicherheit auf Unternehmensniveau benötigen

- Zugang zu mehreren Modellanbietern möchten

- Vorhandene AWS-Guthaben haben

Wählen Sie DeepSeek wenn Sie:

- Die kostengünstigste Option möchten

- Gute Qualität zu niedrigen Kosten benötigen

- Häufig transkribieren

Wählen Sie OpenAI wenn Sie:

- Die einfachste Einrichtung möchten

- Zuverlässige, hochwertige Ergebnisse benötigen

- Bereits OpenAI-Guthaben haben

Wählen Sie Anthropic wenn Sie:

- Fortgeschrittenes Reasoning und Genauigkeit benötigen

- Mit komplexen, technischen Inhalten arbeiten

- Claudes spezifische Fähigkeiten wünschen

Prompt-Engineering-Tipps

- Seien Sie spezifisch: "Füllwörter entfernen und Grammatik korrigieren" ist besser als "verbessern"

- Testen Sie Iterationen: Probieren Sie verschiedene Prompts aus, um zu finden was funktioniert

- Kombinieren Sie Anweisungen: "Grammatik korrigieren, Füllwörter entfernen und als Aufzählungspunkte formatieren"

- Berücksichtigen Sie den Kontext: Passen Sie Prompts für verschiedene Anwendungsfälle an (E-Mail vs. Code-Kommentare)

Fehlerbehebung

Verbindungstest Schlägt Fehl

AWS Bedrock:

- Überprüfen Sie, ob IAM-Berechtigungen Bedrock-Modellzugang beinhalten

- Prüfen Sie, ob die Region mit dem Verfügbarkeitsort des Modells übereinstimmt

- Testen Sie AWS CLI:

aws bedrock list-foundation-models --region <region> - Stellen Sie sicher, dass die Modell-ID korrekt ist

DeepSeek/OpenAI/Anthropic:

- Überprüfen Sie, ob der API-Schlüssel gültig ist

- Prüfen Sie, ob Ihr Konto Guthaben/aktives Abonnement hat

- Stellen Sie sicher, dass die Endpoint-URL korrekt ist

- Testen Sie den API-Schlüssel mit curl:bash

curl https://api.deepseek.com/v1/models \ -H "Authorization: Bearer YOUR_API_KEY"

KI-Verbesserung Dauert Zu Lange

Lösungen:

- Wechseln Sie zu einem schnelleren Modell (z.B. GPT-3.5 statt GPT-4)

- Verwenden Sie einen Anbieter mit geringerer Latenz

- Prüfen Sie Ihre Internetverbindung

- Reduzieren Sie die Komplexität des benutzerdefinierten Prompts

Verbesserter Text Ist Falsch

Lösungen:

- Passen Sie Ihren benutzerdefinierten Prompt an, um spezifischer zu sein

- Probieren Sie ein anderes Modell (größere Modelle sind oft genauer)

- Verwenden Sie einen einfacheren Prompt oder das Standardverhalten

- Prüfen Sie zuerst, ob Ihre Basis-Transkription präzise ist

API-Schlüssel Falsch Gespeichert

Lösung:

- Navigieren Sie zu Einstellungen → KI-Verbesserung

- Geben Sie Ihren API-Schlüssel erneut ein

- Gewähren Sie Schlüsselbund-Zugang wenn aufgefordert

- Klicken Sie auf Verbindung Testen zur Überprüfung

Hohe API-Kosten

Lösungen:

- Wechseln Sie zu einem günstigeren Anbieter (DeepSeek)

- Verwenden Sie KI-Verbesserung selektiv (für schnelle Notizen deaktivieren)

- Überwachen Sie die Nutzung im Dashboard Ihres Anbieters

- Erwägen Sie kleinere Modelle zu verwenden

- Optimieren Sie Ihren benutzerdefinierten Prompt um Ausgabe-Token zu reduzieren

Sicherheit und Datenschutz

Datenschutz

Was an KI-Anbieter gesendet wird:

- Nur Texttranskription (nach lokaler Whisper-Verarbeitung)

- Ihr benutzerdefinierter Prompt

- Kein Audio, keine persönlichen Informationen über den Transkriptionstext hinaus

Was NICHT gesendet wird:

- Originale Audioaufnahmen

- Andere Transkriptionen (jede Anfrage ist unabhängig)

- Persönliche Informationen aus Vox-Einstellungen

Sichere Speicherung

- API-Schlüssel: Verschlüsselt im macOS-Schlüsselbund / Windows-Anmeldeinformationsspeicher gespeichert

- Anmeldeinformationen: Werden niemals an Vox-Server übertragen

- Transkriptionen: Können lokal aufbewahrt werden (siehe Audio-Aufbewahrung)

Datenschutzrichtlinien der Anbieter

Überprüfen Sie die Datenschutzrichtlinien Ihres gewählten Anbieters:

Datenverarbeitung

Wenn Sie die KI-Verbesserung aktivieren, werden Ihre Transkriptionen an Drittanbieter-KI-Anbieter gesendet. Wenn Sie mit sensiblen Informationen arbeiten, erwägen Sie:

- Nur lokale Transkription zu verwenden (KI-Verbesserung deaktivieren)

- Anbieter mit starken Datenschutzgarantien zu wählen

- Private Deployments zu nutzen (AWS PrivateLink, Azure Private Link)

Erweiterte Konfiguration

Benutzerdefinierte Endpoints

Einige Anbieter erlauben benutzerdefinierte Endpoints für:

- Private Deployments

- On-Premises-Installationen

- Proxy-Server

- Regionale Optimierungen

Geben Sie benutzerdefinierte Endpoints im Endpoint-Feld bei der Anbieterkonfiguration ein.

LiteLLM für Erweitertes Routing

LiteLLM ermöglicht:

- Einheitliche Schnittstelle zu 100+ LLM-Anbietern

- Automatisches Fallback und Wiederholung

- Lastverteilung über mehrere Anbieter

- Kostenverfolgung und Budgets

Einrichtung:

- LiteLLM-Server bereitstellen: https://docs.litellm.ai

- Anbieter LiteLLM in Vox auswählen

- Ihre LiteLLM-Server-URL eingeben

- Routing in der LiteLLM-Konfiguration einrichten

Umgebungsvariablen

Wenn Sie AWS-CLI-Profile oder Umgebungsvariablen verwenden, respektiert Vox:

AWS_PROFILEAWS_REGIONAWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEY

Nächste Schritte

- Sprachmodelle konfigurieren für bessere Basis-Transkriptionen

- Benutzerdefinierte Wörter hinzufügen zur Verbesserung der Genauigkeit

- Tastaturkürzel einrichten für schnelle Aufnahme

- HUD-Einstellungen anpassen für Aufnahme-Feedback