Amélioration par IA

Fonctionnalité Optionnelle - Vous pouvez ignorer ceci !

Cette étape est complètement optionnelle. Vox fonctionne parfaitement sans l'Amélioration par IA - vos transcriptions seront déjà précises. Configurez ceci uniquement si vous souhaitez polir automatiquement vos transcriptions (corriger la grammaire, supprimer les mots de remplissage comme "euh" ou "ben").

Si vous n'êtes pas sûr de ce que c'est ou ne souhaitez pas le configurer maintenant, n'hésitez pas à passer à la section suivante !

L'Amélioration par IA utilise l'IA (comme ChatGPT ou Claude) pour nettoyer automatiquement vos transcriptions, les rendant plus polies et professionnelles.

Que Fait l'Amélioration par IA ?

En termes simples : Elle prend votre transcription (qui est déjà précise) et la fait sonner plus professionnelle.

Exemple :

- Avant l'IA : "Euh, alors en gros, genre, on doit, euh, planifier une réunion pour, vous voyez, mardi prochain"

- Après l'IA : "Nous devons planifier une réunion pour mardi prochain"

Principaux Avantages

- Corrige la grammaire : Corrige les erreurs automatiquement

- Supprime les mots de remplissage : Élimine "euh", "ben", "genre", etc.

- Le rend plus propre : Plus professionnel et plus facile à lire

- Conserve votre sens : Votre message original reste le même

En Avez-Vous Besoin ?

Vous pourriez vouloir l'Amélioration par IA si :

- Vous utilisez Vox pour des documents ou des e-mails professionnels

- Vous souhaitez des transcriptions polies sans édition

- Vous êtes à l'aise avec les services d'IA (comme ChatGPT)

Vous N'AVEZ PAS besoin de l'Amélioration par IA si :

- Vous prenez juste des notes rapides pour vous-même

- Vous préférez une confidentialité complète (l'Amélioration par IA envoie du texte à des services externes)

- Vous ne vous dérangez pas d'éditer les transcriptions manuellement

- Vous ne savez pas ce qu'est une "clé API"

Note de Confidentialité

Votre audio ne quitte jamais votre appareil. Seule la transcription textuelle est envoyée au service d'IA que vous choisissez. Si vous voulez une confidentialité complète, laissez l'Amélioration par IA désactivée.

Comment le Configurer

Prérequis

Pour utiliser l'Amélioration par IA, vous avez besoin de :

- Un compte avec un service d'IA (comme OpenAI, Anthropic, AWS, etc.)

- Une clé API (pensez-y comme un mot de passe pour le service d'IA)

- Quelques dollars pour les coûts d'IA (généralement $0,01-0,05 par transcription)

Prochainement : Nous travaillons sur une option payante intégrée pour que vous n'ayez pas à configurer cela vous-même.

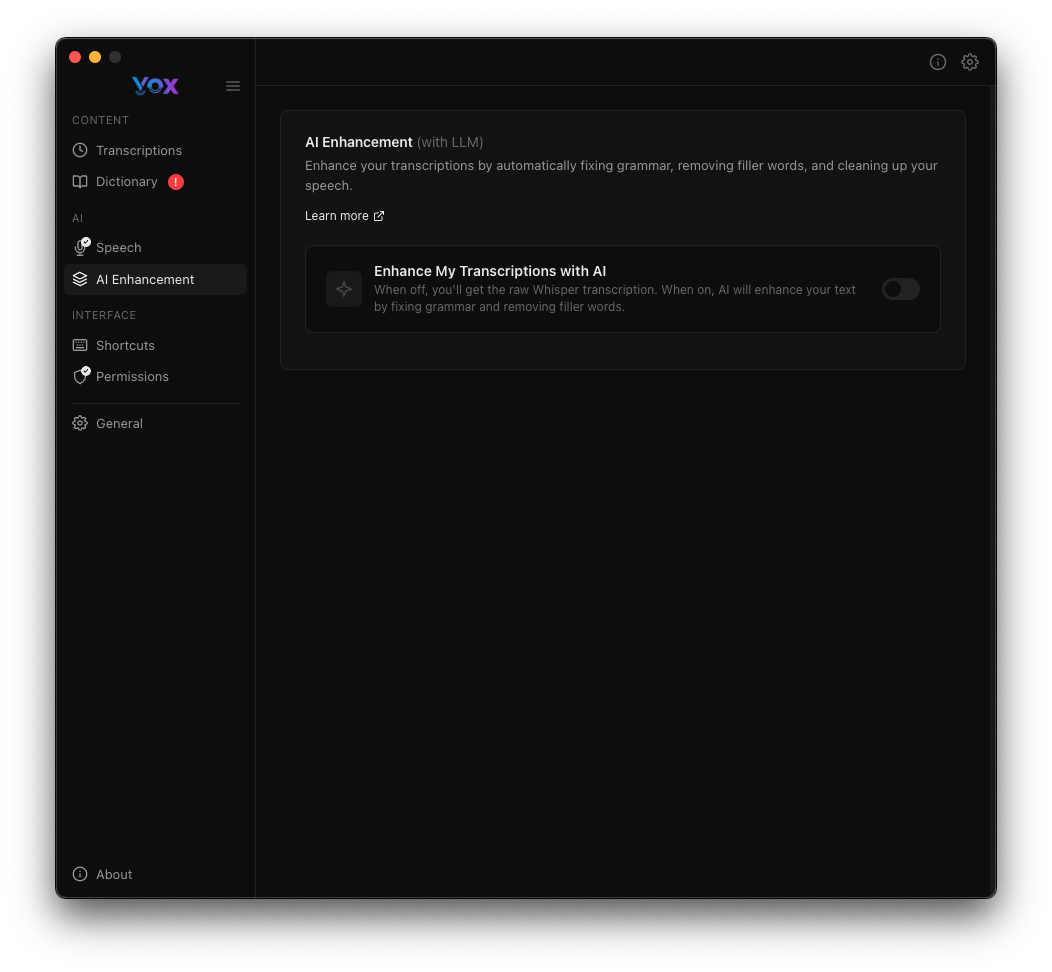

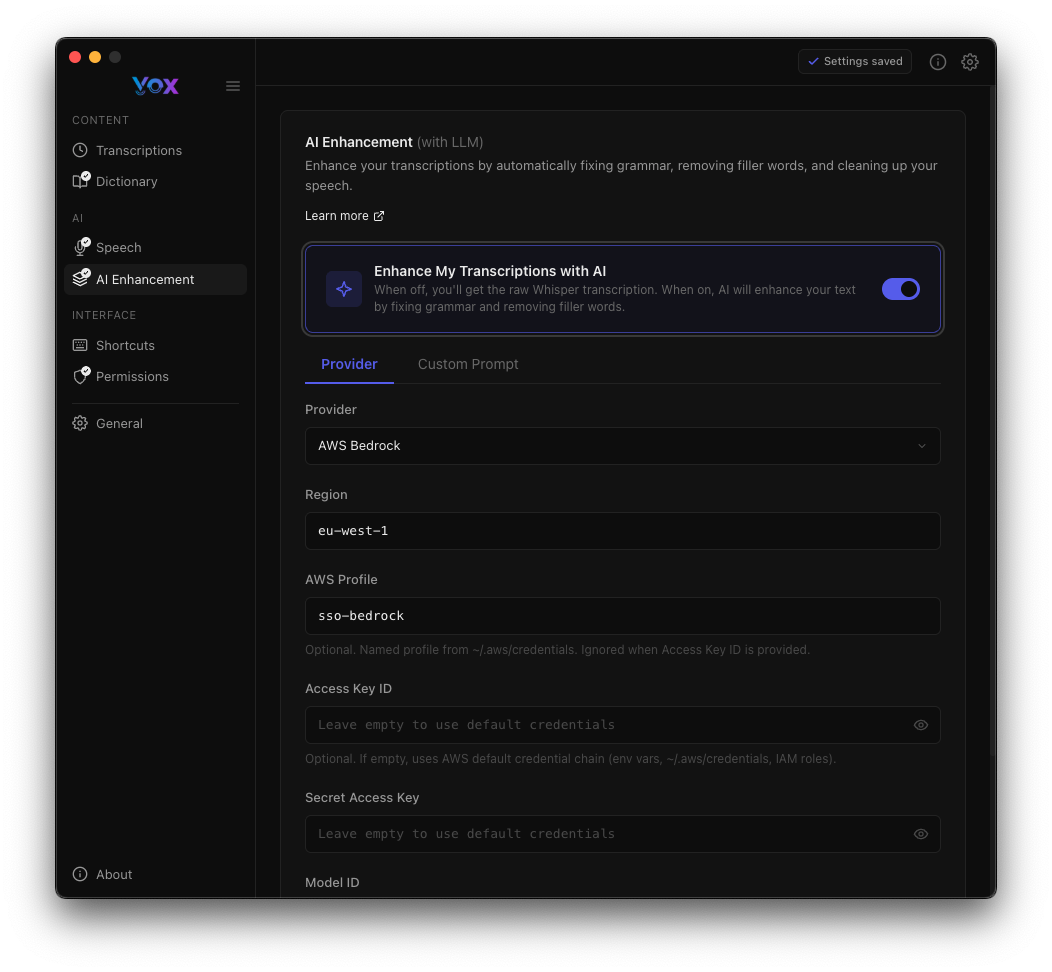

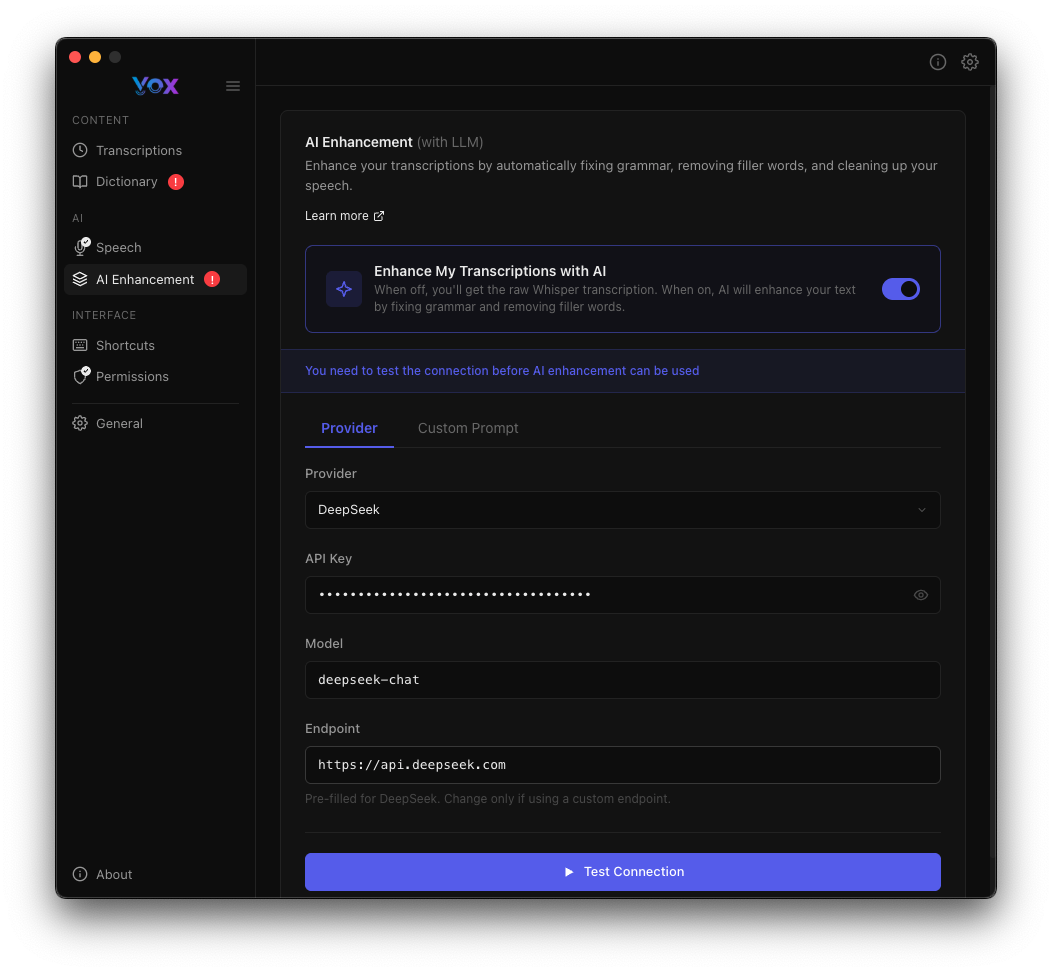

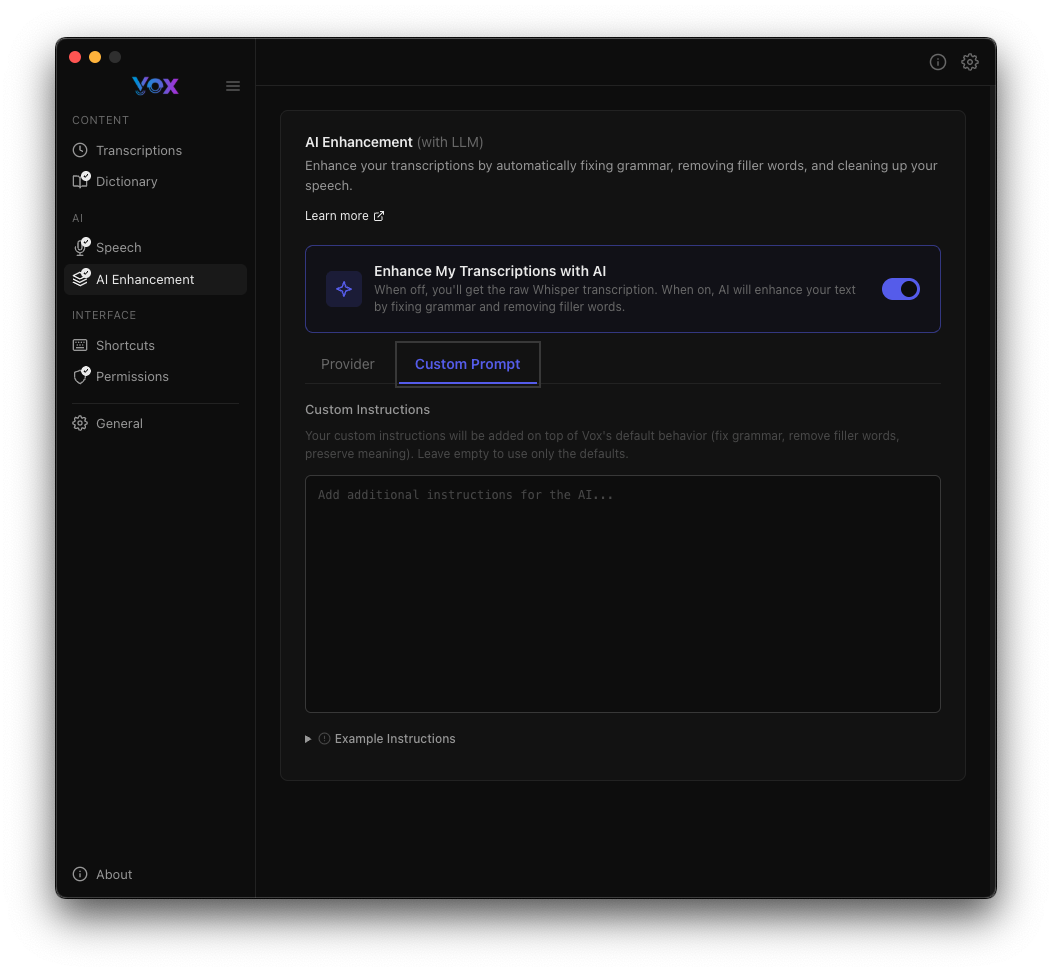

Étape 1 : Ouvrir les Paramètres d'Amélioration par IA

- Ouvrez les paramètres de Vox

- Cliquez sur Amélioration par IA dans la barre latérale

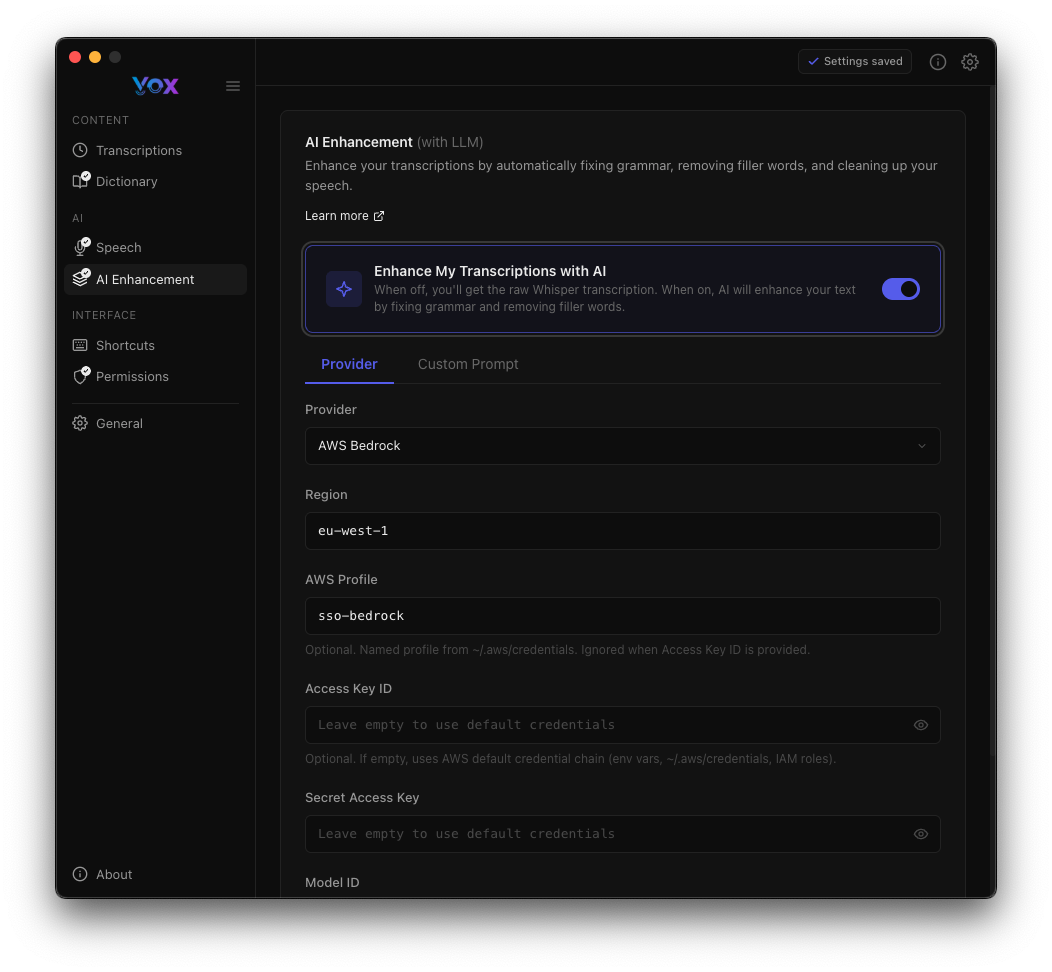

- Activez Améliorer Mes Transcriptions avec l'IA

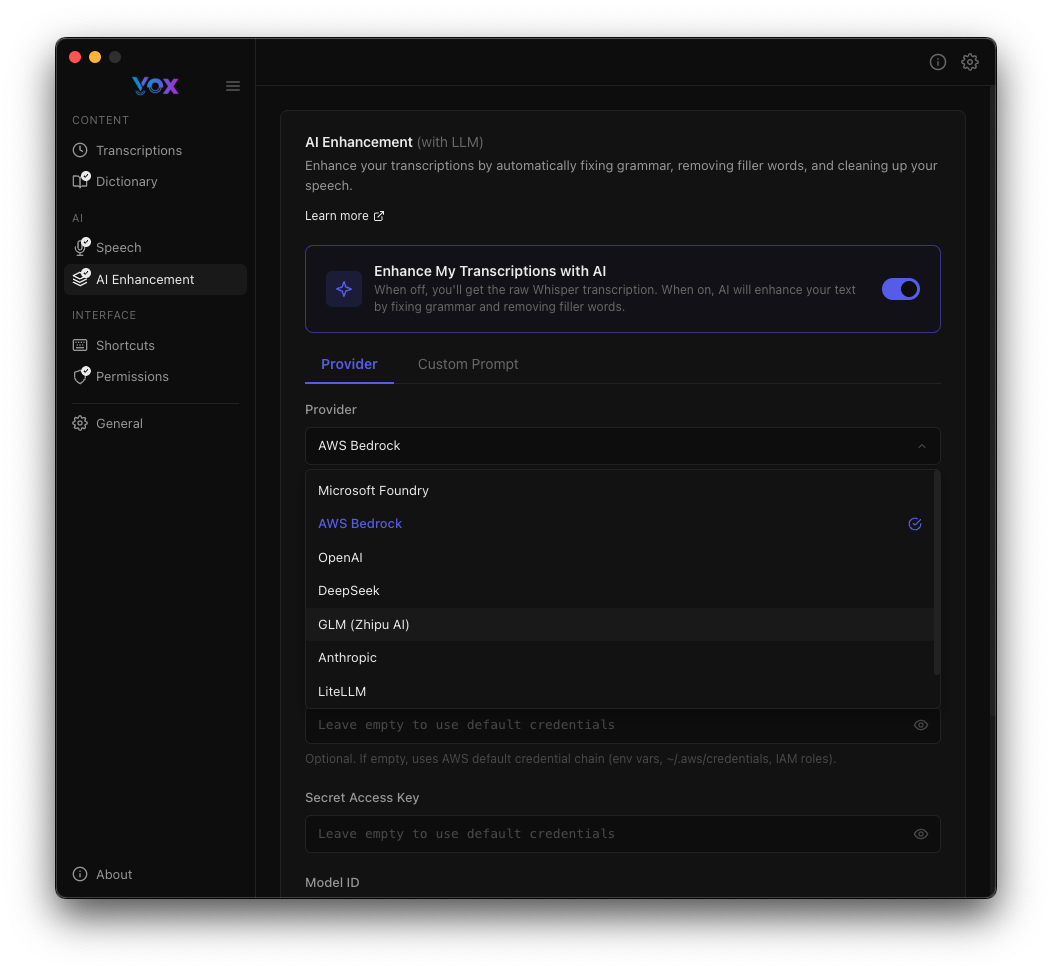

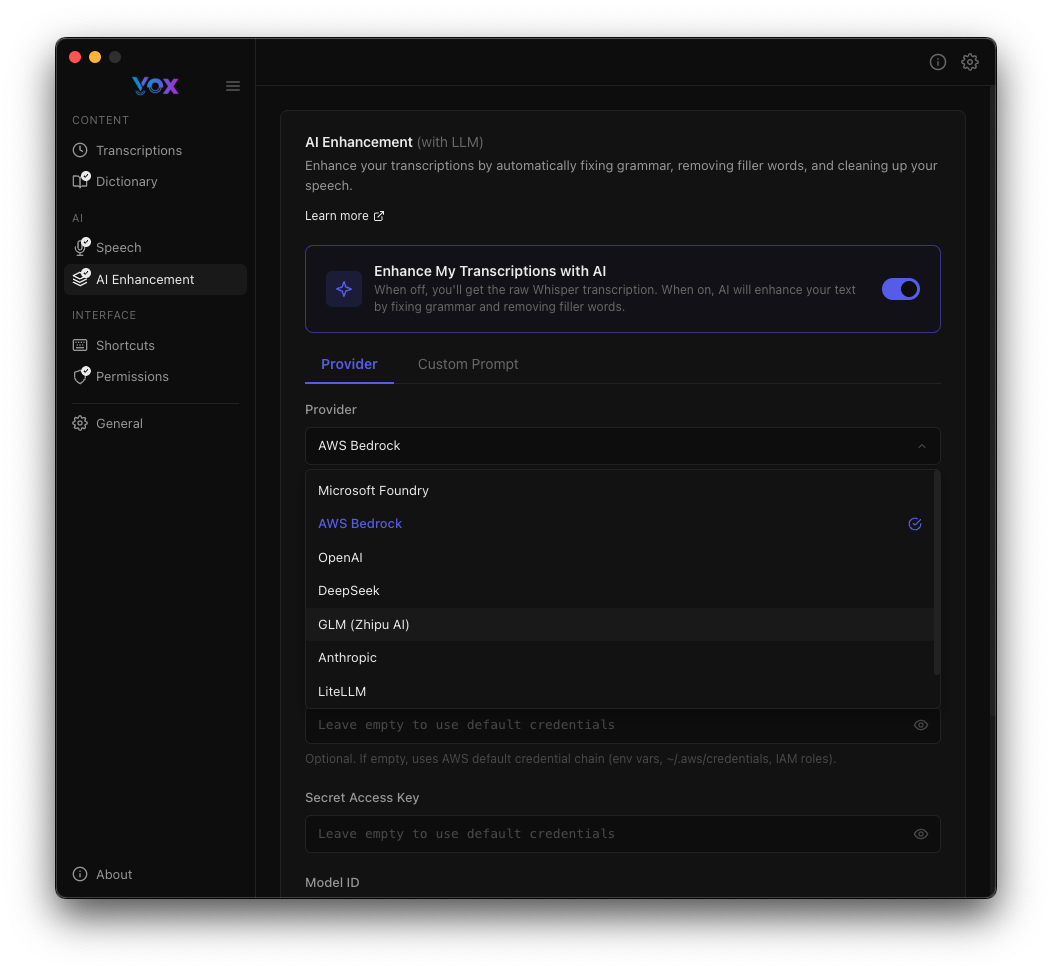

Étape 2 : Choisir Votre Fournisseur d'IA

Sélectionnez un service d'IA dans le menu déroulant. Options populaires :

- OpenAI (ChatGPT) - Le plus populaire, facile à utiliser

- Anthropic (Claude) - Bonne qualité, axé sur la confidentialité

- AWS Bedrock - Pour les utilisateurs avancés

- Ollama - Exécuter l'IA localement (gratuit, mais nécessite une configuration)

Étape 3 : Ajouter Votre Clé API

- Obtenez une clé API de votre fournisseur choisi (voir les sections des fournisseurs ci-dessous)

- Collez-la dans le champ Clé API

- Cliquez sur Tester la Connexion pour vous assurer que ça fonctionne

Première Fois ?

Si vous n'avez jamais utilisé d'APIs d'IA auparavant, nous recommandons de commencer avec OpenAI (ChatGPT). Ils ont des tarifs clairs ($0,002 par requête) et une bonne documentation.

Fournisseurs Pris en Charge

Vox prend en charge plusieurs fournisseurs d'IA. Cliquez sur le menu déroulant Fournisseur pour sélectionner :

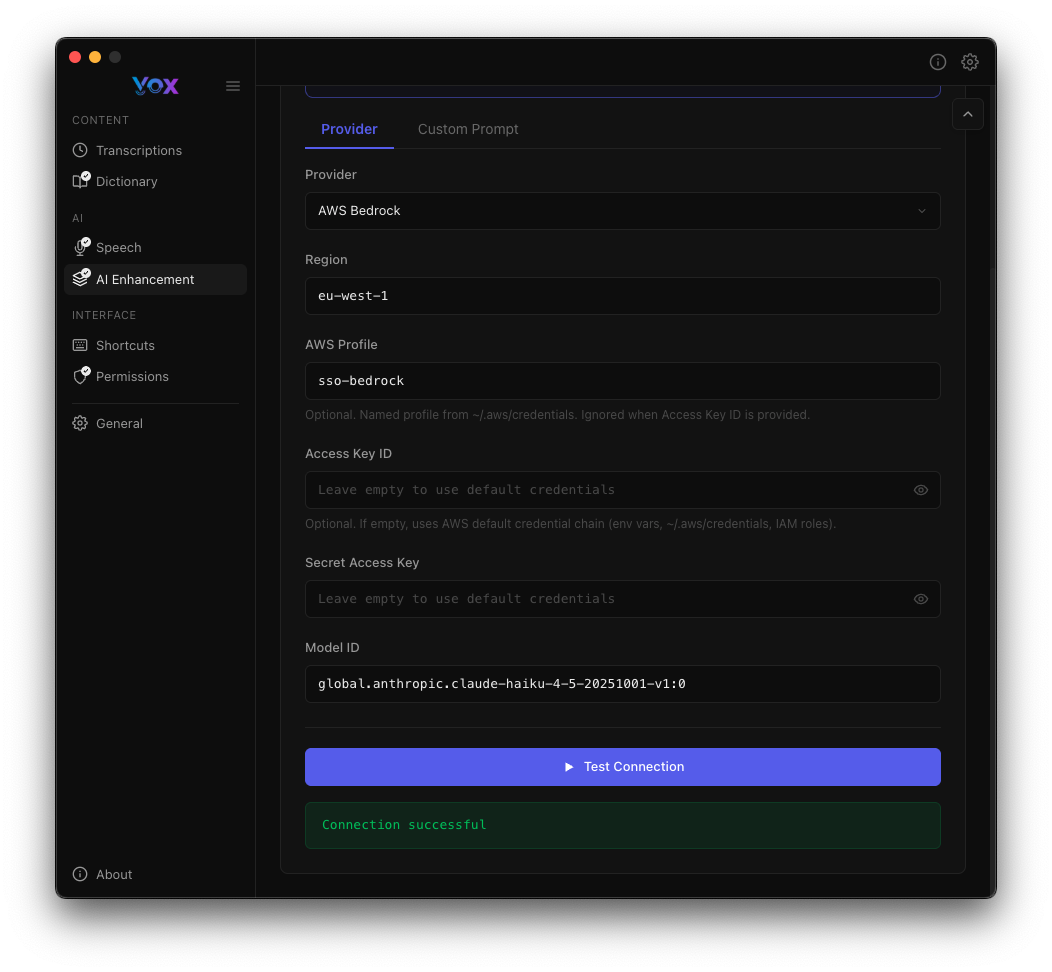

AWS Bedrock

Meilleur pour : Utilisation en production, environnements d'entreprise, variété de modèles

Configuration :

Région

- Sélectionnez votre région AWS (ex. :

eu-west-1) - Choisissez une région proche de vous pour une latence réduite

Profil AWS

- Entrez le nom de votre profil AWS (ex. :

sso-bedrock) - Utilise les identifiants AWS CLI configurés sur votre système

ID de Clé d'Accès

- Optionnel : Entrez votre clé d'accès AWS

- Requis si vous n'utilisez pas de profils AWS CLI

- Format :

AKIA...(20 caractères)

Clé d'Accès Secrète

- Optionnel : Entrez votre clé d'accès secrète

- Requis si vous n'utilisez pas de profils AWS CLI

- Stockée de manière sécurisée dans le Trousseau macOS / Gestionnaire d'identifiants Windows

ID de Modèle

- Spécifiez le modèle Bedrock à utiliser

- Exemple :

global.anthropic.claude-haiku-4-5-20251101-v1:0 - Voir Modèles AWS Bedrock

Configuration AWS

AWS Bedrock nécessite :

- Un compte AWS avec accès à Bedrock

- Des autorisations IAM pour le modèle sélectionné

- AWS CLI configuré avec SSO ou des clés d'accès

DeepSeek

Meilleur pour : Amélioration par IA économique, bonnes performances

Configuration :

Clé API

- Obtenez une clé API sur DeepSeek

- Stockée de manière sécurisée dans le Trousseau macOS / Gestionnaire d'identifiants Windows

Modèle

- Spécifiez le modèle (ex. :

deepseek-chat) - Voir Documentation API DeepSeek

Endpoint

- Par défaut :

https://api.deepseek.com - Modifiez seulement si vous utilisez un endpoint personnalisé

Microsoft Foundry

Meilleur pour : Utilisateurs Azure, intégration d'entreprise

Configuration :

- Similaire à AWS Bedrock

- Nécessite un abonnement Azure et un accès à Foundry

- Utilise l'authentification Azure

OpenAI

Meilleur pour : Modèles GPT de haute qualité, configuration la plus simple

Configuration :

- Clé API : Obtenez sur OpenAI Platform

- Modèle :

gpt-4,gpt-4-turbo,gpt-3.5-turbo, etc. - Endpoint : Par défaut

https://api.openai.com/v1

GLM (Zhipu AI)

Meilleur pour : Transcription en langue chinoise, utilisateurs Asie-Pacifique

Configuration :

- Clé API : Obtenez sur Zhipu AI

- Modèle :

glm-4,glm-4-air, etc.

Anthropic

Meilleur pour : Modèles Claude avec haute capacité de raisonnement

Configuration :

- Clé API : Obtenez sur Anthropic Console

- Modèle :

claude-3-5-sonnet-20241022,claude-3-opus-20240229, etc.

LiteLLM

Meilleur pour : Utilisateurs avancés, routage de modèles personnalisé, API unifiée

Configuration :

- Endpoint : URL de votre serveur LiteLLM

- Prend en charge le routage vers 100+ fournisseurs LLM

- Voir Documentation LiteLLM

Tester Votre Connexion

Après avoir configuré votre fournisseur :

- Cliquez sur Tester la Connexion

- Attendez que le test se termine

- Recherchez le message "Connexion réussie !"

Si le test échoue :

- Vérifiez que vos clés API/identifiants sont corrects

- Vérifiez votre connexion internet

- Assurez-vous que votre compte a accès au modèle spécifié

- Examinez les messages d'erreur pour des problèmes spécifiques

Accès au Trousseau

Vous devrez peut-être accorder la permission Trousseau pour stocker les clés API de manière sécurisée.

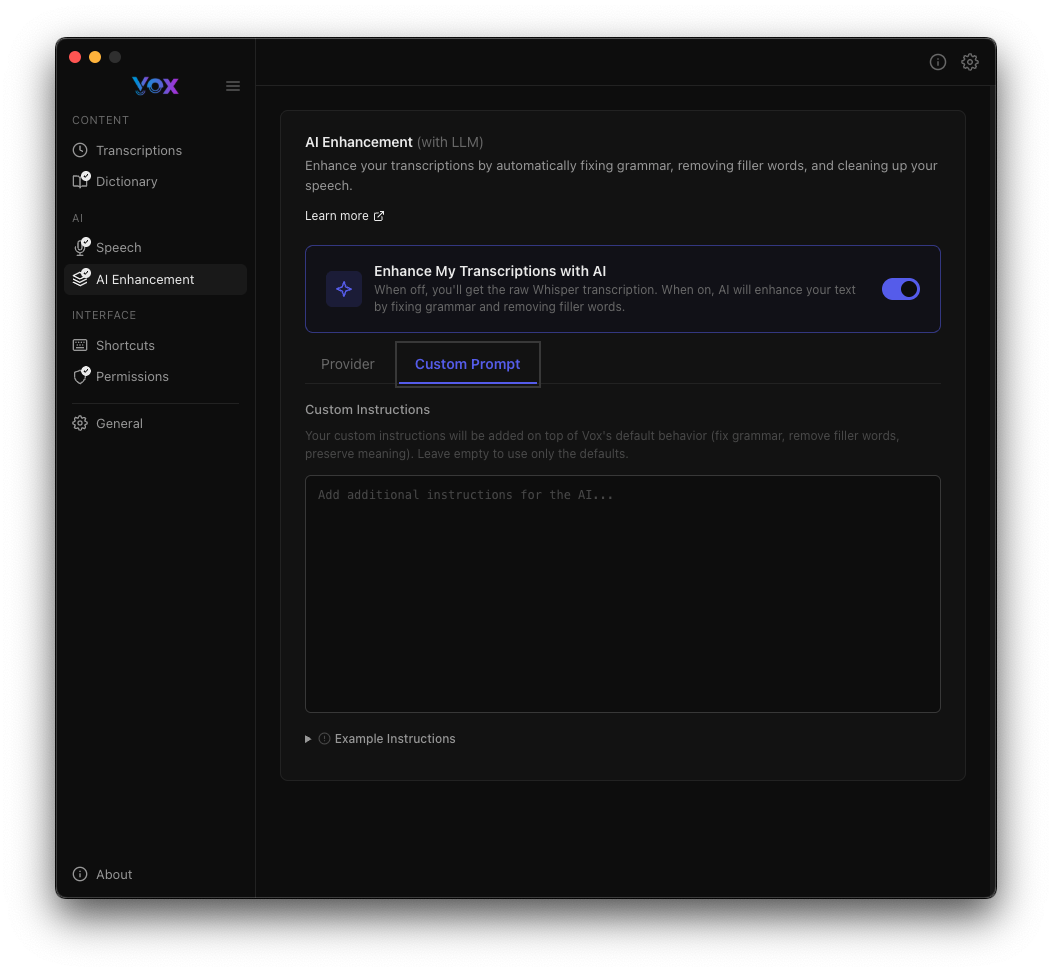

Prompts Personnalisés

Personnalisez comment l'IA améliore vos transcriptions :

Utiliser des Prompts Personnalisés

- Cliquez sur l'onglet Prompt Personnalisé

- Entrez vos instructions personnalisées

- Les paramètres sont sauvegardés automatiquement

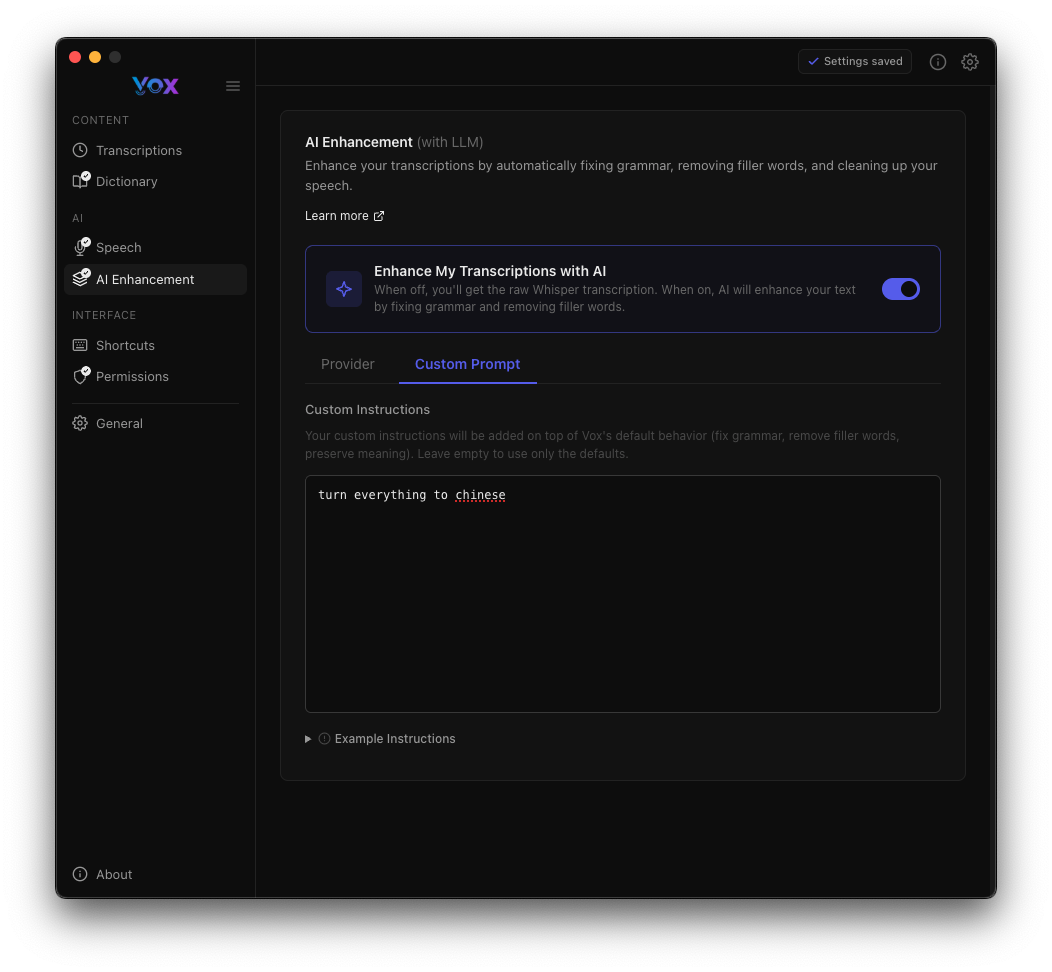

Exemple de Prompt Personnalisé

Exemple de prompt :

turn everything to chineseCela traduira toutes les transcriptions en chinois.

Prompt Par Défaut

Si vous ne spécifiez pas de prompt personnalisé, Vox utilise une instruction par défaut pour :

- Corriger la grammaire et l'orthographe

- Supprimer les mots de remplissage (euh, ben, genre, etc.)

- Préserver les termes techniques et les noms

- Maintenir le sens original

Conseils pour les Prompts

Bons prompts :

- "Corriger la grammaire mais garder le jargon technique"

- "Supprimer les mots de remplissage et formater en points"

- "Traduire en espagnol et corriger la grammaire"

- "Rendre plus formel et professionnel"

Éviter :

- Les prompts extrêmement longs (peuvent atteindre les limites de tokens)

- Les prompts qui changent le sens de manière significative

- Les prompts qui ajoutent des informations non présentes dans la transcription

Expérimentez

Testez différents prompts avec la même transcription pour trouver ce qui fonctionne le mieux pour votre cas d'usage.

Instructions d'Exemple

Exemple d'instructions personnalisées affichées dans l'interface :

Cliquez sur Instructions d'Exemple pour voir des exemples de prompts :

- "Ajoutez des instructions supplémentaires en plus du comportement par défaut de Vox comme la grammaire, supprimer les mots de remplissage, les phrases d'hésitation"

- Fournit des conseils sur la façon de structurer vos instructions personnalisées

Guides Spécifiques aux Fournisseurs

Configuration AWS Bedrock

Prérequis :

- Compte AWS avec accès à Bedrock

- Accès au modèle activé dans la Console AWS

- Autorisations IAM configurées

Utilisation du Profil AWS CLI (Recommandé) :

# Configurer AWS CLI avec SSO

aws configure sso

# Tester votre profil

aws bedrock list-foundation-models --profile sso-bedrockDans Vox :

- Sélectionnez le fournisseur AWS Bedrock

- Entrez le nom du profil (ex. :

sso-bedrock) - Sélectionnez la région

- Entrez l'ID du modèle

- Cliquez sur Tester la Connexion

Utilisation des Clés d'Accès :

- Créez des clés d'accès dans AWS IAM

- Entrez l'ID de Clé d'Accès et la Clé d'Accès Secrète dans Vox

- Sélectionnez la région et le modèle

- Cliquez sur Tester la Connexion

Sécurité

Stockez les clés d'accès de manière sécurisée. Les profils AWS CLI avec SSO sont plus sécurisés que les clés d'accès statiques.

Configuration DeepSeek

Prérequis :

- Compte sur platform.deepseek.com

- Clé API générée

Configuration :

- S'inscrire sur DeepSeek

- Générer une clé API

- Dans Vox, sélectionner le fournisseur DeepSeek

- Entrer votre clé API

- Utiliser le modèle

deepseek-chat - Cliquer sur Tester la Connexion

Coût : DeepSeek est économique par rapport aux autres fournisseurs.

Configuration OpenAI

Prérequis :

- Compte OpenAI

- Clé API avec crédits

Configuration :

- Obtenir la clé API sur platform.openai.com/api-keys

- Dans Vox, sélectionner le fournisseur OpenAI

- Entrer votre clé API

- Choisir le modèle (ex. :

gpt-4-turbo,gpt-3.5-turbo) - Cliquer sur Tester la Connexion

Coût : OpenAI facture par token. GPT-4 est plus cher mais de meilleure qualité que GPT-3.5.

Considérations de Coût

Aperçu des Tarifs

Les coûts d'Amélioration par IA varient selon le fournisseur :

| Fournisseur | Coût par 1M tokens | Notes |

|---|---|---|

| DeepSeek | ~$0,14 | Le plus économique |

| OpenAI GPT-3.5 | ~$0,50 | Bon rapport qualité-prix |

| OpenAI GPT-4 | ~$10-30 | Haute qualité, cher |

| AWS Bedrock | ~$0,25-15 | Varie selon le modèle |

| Anthropic Claude | ~$3-15 | Haute qualité |

Estimation des Coûts

Transcription moyenne : 50-100 tokens Coût par transcription : $0,001-0,01 (selon le fournisseur)

Exemple d'utilisation :

- 100 transcriptions/jour avec DeepSeek : ~$0,50/mois

- 100 transcriptions/jour avec GPT-4 : ~$30/mois

Économisez de l'Argent

- Utilisez des modèles plus petits et moins chers pour les transcriptions simples

- Utilisez GPT-4 ou Claude uniquement quand vous avez besoin de la plus haute qualité

- DeepSeek offre le meilleur rapport prix-performance

Tarifs Futurs

IA Intégrée Prochainement

Actuellement, Vox utilise vos propres clés API pour l'amélioration par IA. À l'avenir, nous pourrions proposer une option de modèle d'IA intégré payant pour plus de commodité.

Cela éliminerait le besoin de gérer les clés API et offrirait potentiellement :

- Configuration simplifiée (pas de clés API nécessaires)

- Tarification mensuelle prévisible

- Facturation intégrée

- Modèles optimisés pour la transcription

Restez à l'écoute pour les mises à jour !

Meilleures Pratiques

Quand Utiliser l'Amélioration par IA

Utilisez l'Amélioration par IA pour :

- E-mails et documentation professionnels

- Notes de réunion et résumés

- Création de contenu et écriture

- Communications formelles

Ignorez l'Amélioration par IA pour :

- Notes personnelles rapides

- Quand une confidentialité complète est requise

- Transcriptions simples et courtes

- Quand la vitesse est critique

Choisir un Fournisseur

Choisissez AWS Bedrock si vous :

- Utilisez déjà AWS pour d'autres services

- Avez besoin d'une sécurité de niveau entreprise

- Voulez accès à plusieurs fournisseurs de modèles

- Avez des crédits AWS existants

Choisissez DeepSeek si vous :

- Voulez l'option la plus économique

- Avez besoin d'une bonne qualité à faible coût

- Transcrivez fréquemment

Choisissez OpenAI si vous :

- Voulez la configuration la plus simple

- Avez besoin de résultats fiables et de haute qualité

- Avez déjà des crédits OpenAI

Choisissez Anthropic si vous :

- Avez besoin de raisonnement avancé et de précision

- Travaillez avec du contenu complexe et technique

- Voulez les capacités spécifiques de Claude

Conseils d'Ingénierie de Prompts

- Soyez spécifique : "Supprimer les mots de remplissage et corriger la grammaire" est mieux qu'"améliorer"

- Testez des itérations : Essayez différents prompts pour trouver ce qui fonctionne

- Combinez les instructions : "Corriger la grammaire, supprimer les remplissages et formater en points"

- Considérez le contexte : Ajustez les prompts pour différents cas d'usage (e-mail vs. commentaires de code)

Dépannage

Échec du Test de Connexion

AWS Bedrock :

- Vérifiez que les autorisations IAM incluent l'accès au modèle Bedrock

- Vérifiez que la région correspond à l'endroit où le modèle est disponible

- Testez AWS CLI :

aws bedrock list-foundation-models --region <region> - Assurez-vous que l'ID du modèle est correct

DeepSeek/OpenAI/Anthropic :

- Vérifiez que la clé API est valide

- Vérifiez que votre compte a des crédits/abonnement actif

- Assurez-vous que l'URL de l'endpoint est correcte

- Testez la clé API avec curl :bash

curl https://api.deepseek.com/v1/models \ -H "Authorization: Bearer YOUR_API_KEY"

L'Amélioration par IA Prend Trop Longtemps

Solutions :

- Passez à un modèle plus rapide (ex. : GPT-3.5 au lieu de GPT-4)

- Utilisez un fournisseur avec une latence plus faible

- Vérifiez votre connexion internet

- Réduisez la complexité du prompt personnalisé

Le Texte Amélioré Est Incorrect

Solutions :

- Ajustez votre prompt personnalisé pour être plus spécifique

- Essayez un modèle différent (les modèles plus grands sont souvent plus précis)

- Utilisez un prompt plus simple ou le comportement par défaut

- Vérifiez d'abord que votre transcription de base est précise

Clé API Stockée Incorrectement

Solution :

- Naviguez vers Paramètres → Amélioration par IA

- Ressaisissez votre clé API

- Accordez l'accès au Trousseau quand demandé

- Cliquez sur Tester la Connexion pour vérifier

Coûts API Élevés

Solutions :

- Passez à un fournisseur moins cher (DeepSeek)

- Utilisez l'Amélioration par IA sélectivement (désactivez pour les notes rapides)

- Surveillez l'utilisation dans le tableau de bord de votre fournisseur

- Envisagez d'utiliser des modèles plus petits

- Optimisez votre prompt personnalisé pour réduire les tokens de sortie

Sécurité et Confidentialité

Confidentialité des Données

Ce qui est envoyé aux fournisseurs d'IA :

- Uniquement la transcription textuelle (après le traitement local de Whisper)

- Votre prompt personnalisé

- Pas d'audio, pas d'informations personnelles au-delà du texte de transcription

Ce qui N'est PAS envoyé :

- Les enregistrements audio originaux

- Les autres transcriptions (chaque requête est indépendante)

- Les informations personnelles des paramètres Vox

Stockage Sécurisé

- Clés API : Stockées chiffrées dans le Trousseau macOS / Gestionnaire d'identifiants Windows

- Identifiants : Jamais transmis aux serveurs Vox

- Transcriptions : Peuvent être conservées localement (voir Rétention Audio)

Politiques de Confidentialité des Fournisseurs

Consultez les politiques de confidentialité de votre fournisseur choisi :

Traitement des Données

Quand vous activez l'Amélioration par IA, vos transcriptions sont envoyées à des fournisseurs d'IA tiers. Si vous travaillez avec des informations sensibles, envisagez :

- D'utiliser uniquement la transcription locale (désactiver l'Amélioration par IA)

- De choisir des fournisseurs avec de fortes garanties de confidentialité

- D'utiliser des déploiements privés (AWS PrivateLink, Azure Private Link)

Configuration Avancée

Endpoints Personnalisés

Certains fournisseurs permettent des endpoints personnalisés pour :

- Les déploiements privés

- Les installations sur site

- Les serveurs proxy

- Les optimisations régionales

Entrez des endpoints personnalisés dans le champ Endpoint lors de la configuration d'un fournisseur.

LiteLLM pour le Routage Avancé

LiteLLM permet :

- Interface unifiée vers 100+ fournisseurs LLM

- Fallback et réessai automatiques

- Équilibrage de charge entre plusieurs fournisseurs

- Suivi des coûts et budgets

Configuration :

- Déployer le serveur LiteLLM : https://docs.litellm.ai

- Sélectionner le fournisseur LiteLLM dans Vox

- Entrer l'URL de votre serveur LiteLLM

- Configurer le routage dans la configuration LiteLLM

Variables d'Environnement

Si vous utilisez des profils AWS CLI ou des variables d'environnement, Vox respecte :

AWS_PROFILEAWS_REGIONAWS_ACCESS_KEY_IDAWS_SECRET_ACCESS_KEY

Prochaines Étapes

- Configurer les modèles vocaux pour de meilleures transcriptions de base

- Ajouter des mots personnalisés pour améliorer la précision

- Configurer les raccourcis clavier pour un enregistrement rapide

- Ajuster les paramètres HUD pour le retour d'enregistrement